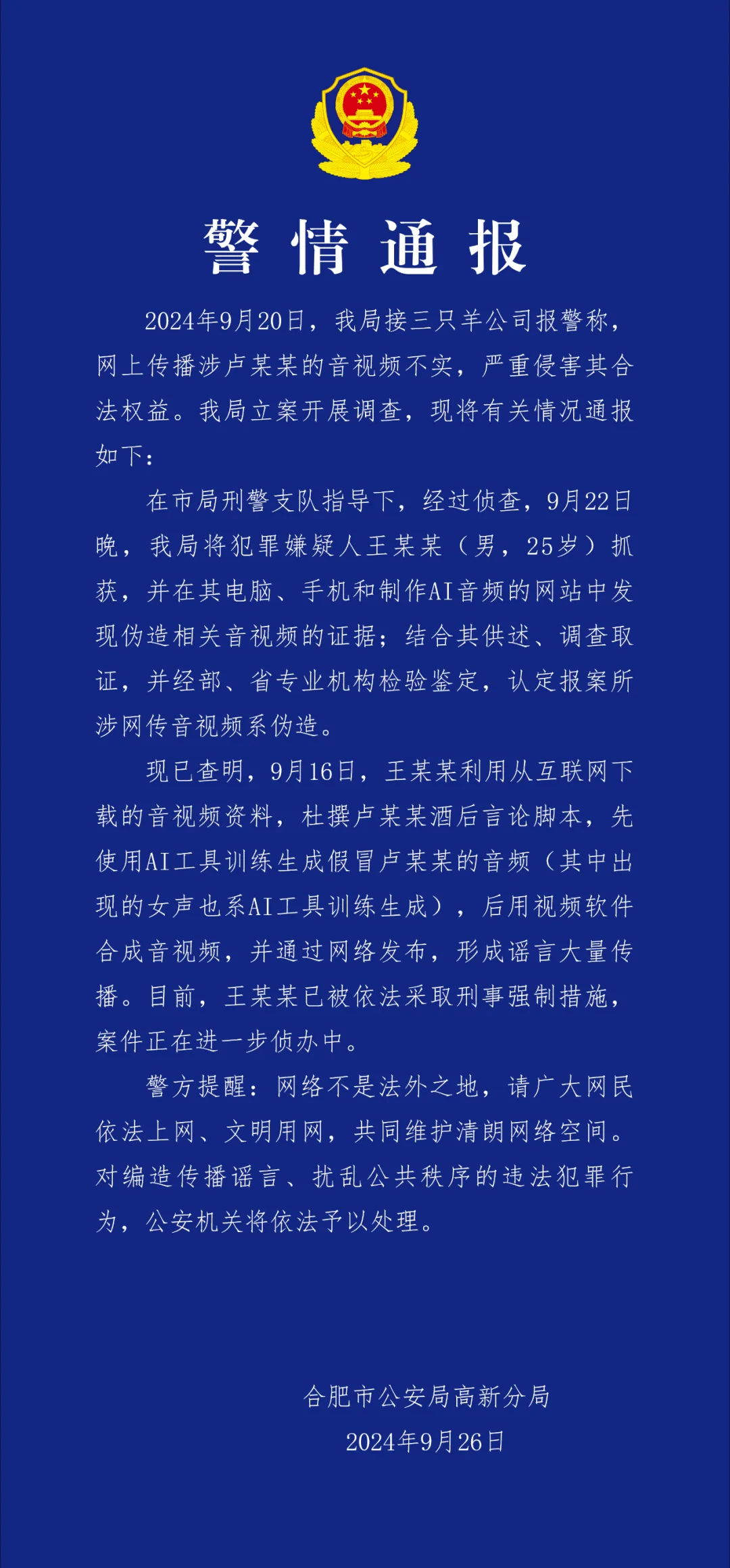

(网经社讯)9月26日,一则警情通报,将深陷舆情漩涡的三只羊又拉到人们眼前!合肥市公安局高新分局发布警情通报称,网上传播涉卢某某的音视频属于伪造,是AI工具训练生成,嫌疑人王某某杜撰酒后言论脚本,使用AI工具和视频软件生成假冒卢某某的音视频,并大量传播。警方表示,为了确认音视频的真实性,警方将相关证据送交部、省专业机构进行检验鉴定。经过专业机构的严格鉴定,最终确认报案所涉的网传音视频系伪造。

如果侦查属实,嫌疑人可能涉嫌两个罪名,其一是涉嫌诽谤罪,根据《中华人民共和国刑法》第二百四十六条的规定,如果AI生成的谣言内容涉及对他人进行侮辱或诽谤,且情节严重,可能构成侮辱罪或诽谤罪,犯侮辱罪、诽谤罪的,处三年以下有期徒刑;其二,涉嫌寻衅滋事罪。根据《中华人民共和国刑法》第二百九十三条的规定,利用AI技术编造并传播虚假信息,造成公共场所秩序严重混乱的,或对受害人生活造成严重的影响,则可能构成寻衅滋事罪。犯寻衅滋事罪的,处五年以下有期徒刑、拘役或者管制。目前警方尚未披露具体罪名,但根据现有事实情况,构成诽谤罪的概率较大。

“深度伪造”犯罪频发

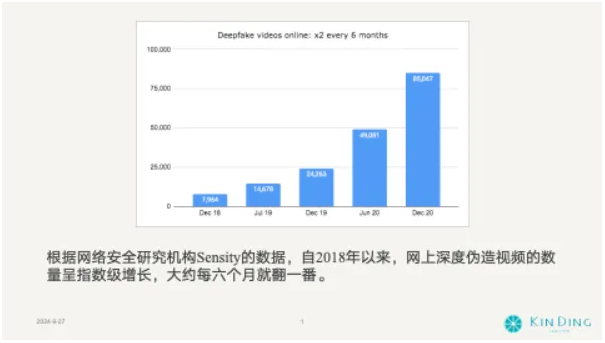

这类通过AI伪造音视频的犯罪案件已经不是第一案,近年来已经有案件爆发的趋势。

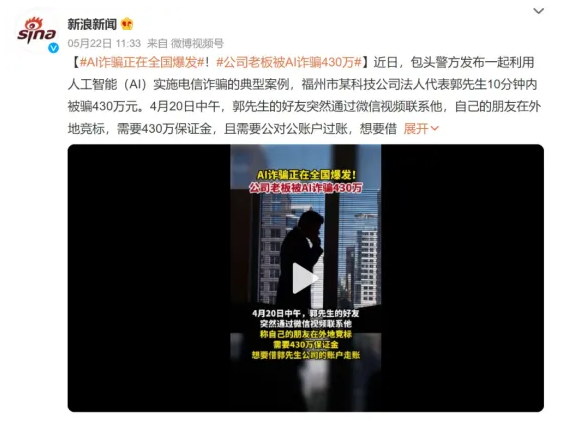

2023年5月,包头警方就破获一起利用AI深度伪造实施的诈骗案件,短短10分钟受害人被骗取了430万元。受害人郭某是福州市某公司法人代表,其好友突然通过微信视频联系到他,称在外地投标,需要430万元保证金,且需要公对公账户过账,所以想要借用郭先生公司的账户走一下账。从视频里看,那确实是自己的朋友,声音也一模一样。出于对老朋友的信任,郭某就转账了430万元,幸运的是,接到报警后,福州、包头两地警银迅速启动止付机制,成功止付拦截336.84万元,但仍有93.16万元被转移。

2024年5月,韩国也发生一起AI深度伪造淫秽影像的恶劣案件,即利用AI换脸制造色情图频,并通过社交媒体平台传播的性犯罪行为被大量曝光。韩国当地媒体报道,首尔大学毕业生朴某和姜某,从2021年7月至2024年4月的3年多里,盗用女性同学、熟人的照片,用深度伪造技术换脸合成色情制品,在Telegram上建立了近200个网络聊天室进行传播,警方称,朴某共参与制作、传播约1700份非法照片和视频,受害女性多达61人。

随着舆论在各大社交媒体上发酵,韩国政府也出面作出表态。韩国总统尹锡悦表示,恶意利用深度伪造技术是犯罪行为,希望有关部门通过掌握实际情况和调查,彻底根除此类数字技术犯罪。韩国警方已成立特别工作组,8月28日起,会专门对深度伪造性犯罪等虚假视频案件展开为期7个月的专项行动。警方统计显示,韩国今年前7个月共有297宗深伪色情罪案,较去年全年的180宗更高。

实际上,深度伪造这一技术犯罪,这两年在全球都有出现。

在国内,今年6月,“男子用AI伪造学生同事近7000张裸照”冲上微博热搜。据央视新闻消息,犯罪嫌疑人白某某是一家互联网公司的技术员,他用AI“一键去衣”技术,深度伪造淫秽图片近7000张,再每张1.5元卖出,赚了将近一万元。图片涉及女性人数多,包括学生、教师、同事。目前白某某已被提起公诉。一名被警方抓获的犯罪嫌疑人白某某原本是一家互联网公司的技术员,他因为使用AI去衣技术,制作、贩卖淫秽物品而涉嫌犯罪。

针对这一案件,检察机关认为,被告人白某某以牟利为目的,制作、贩卖淫秽物品,情节严重,其行为触犯了《中华人民共和国刑法》的相关规定,应当以制作、贩卖淫秽物品牟利罪追究其刑事责任。

今年1月,美国著名歌手泰勒·斯威夫特(Taylor Swift)也成为了AI深度伪造的受害者,大量由AI生成的泰勒不雅照在各大社交平台疯转,浏览量过千万,引发公众关注。

此外,在8月份,埃隆·马斯克(Elon Musk)也因AI伪造技术卷入了一场诈骗事件。82岁的退休老人史蒂夫·比彻姆(Steve Beauchamp)在网上看到了一段声称由马斯克亲自承诺收益的投资视频,随后他联系了视频背后的推销公司,并投资了超过69万美元。随后,这些钱就落入了诈骗犯之手。这些诈骗者篡改了一段马斯克的真实采访,利用AI技术替换了他的声音,并微调了他的口型,以匹配他们为这个数字人编写的新剧本。对于一般观众来说,这种操作几乎察觉不出。

“深度伪造”技术的解构

深度伪造是一种利用 AI 等新兴技术操纵音视频、图像或文本内容的技术,其目的是产生误导效果。深度伪造最初主要用于娱乐目的,但后来逐渐演变为网络犯罪的工具,如近年来频发的利用伪造声音和人像进行的电信诈骗案件。2024 年 1 月,世界经济论坛发布的《2024 年全球风险报告》将“AI 衍生的错误信息和虚假信息及其对社会两极分化的影响”列为未来两年的十大风险之首。

“深度伪造”作为“深度学习”( deep learning) 与“伪造”( fake) 的融合,通常是指基于人工智能合成技术,将已有的视频、音频、图片叠加至目标影片或图像上,从而创制出新的影音图像的技术。

“深度伪造”技术合成的视频、音频之所以能起到以假乱真的效果,主要源于“学习—监督”算法的设定与应用:一方面通过“深度学习”技术的应用,使程序具有对样本进行深度分析、转化、重构的能力,能在短时间内提炼出样本视频、音频、图像的共性,合成新的密钥,在此基础上创制学习成果并予以输出;另一方面通过“生成式对抗网络”算法模型的设定,使“深度伪造”技术能够自动、反复地对已生成的视频、音频、图像进行修正、重构,并在自动学习的过程中不断提升成果质量,达到“温故而知新”的效果。

所谓的生成对抗网络是非监督式学习的一种方法,由两个类神经网络模组互为竞争,一是差异鉴别器网络(Discriminator Network),另一是生成器网络(Generator Network)。通过让两个神经网络相互博弈的方式进行学习。生成式对抗网络是用来愚弄刺激差异鉴别器网络的,只要提供训练资料集,生成器网络就会产生和训练数据资料集相同统计数据之新的资料,喂进资料集一张影像,就会产生乍一看相似的影像。而差异鉴别器主要工作则是去区别生成之影像与实际影像间的差异,通过不断监测并给出真或假的反馈,让生成器借此反馈不断调整模组参数,如此来来回回使影像越来越像,最终产生真假难辨的版本。

随着技术的革新,“深度伪造”技术已经不限于视频、音频、图像的合成与伪造,而成为涵盖现实伪造与虚拟现实创作的应用技术。“深度伪造”技术的应用所涵盖的领域包括:

1.人脸更换:通过对视频中的人脸进行更换,使被替换者能够实施自己从未有过的行为;

2.面部重塑:通过对目标对象的口型、语速和面部表情进行重塑,使目标人物表达出非真实性的言论;

3.声音伪造:通过对目标人物的声音进行学习,创制出目标人物的声音模型并进行非真实性的语义表达;

4.全合成:通过软件创建现实中并不存在的人物形象。日本人工智能公司数据网格( Data Grid) 开发的人工智能软件已经能自动生产虚拟人物的全身模型,并将之应用于未来服装行业。

由于音频图像合成技术发展得较为成熟,“深度伪造”技术在实践中主要被用于对视频、音频的合成。上述技术也可以叠加应用,如通过人脸和语音的双重伪造,创制出某一政治家从未发表过的演讲视频。厘清“深度伪造”技术通过何种运作机理完成上述合成过程,无疑是理解该技术的基础,也是确立法律在何种程度上介入这一新兴技术领域的前提。

深度伪造法律规制:AIGC内容标识及溯源检测

随着AI技术发展,生成合成技术不仅在逼真程度上日臻成熟,技术工具的可及性及易用性极大提高。当人人均可低成本地制作、传播深度伪造的内容时,现实与虚拟的界限不再显而易见,互联网信息传播的基本逻辑遭到挑战。

为此,各国已经着手管制并陆续出台了各项法规。美国参议院2018年提出了《恶意深度伪造禁止法案》。2019年6月,美国联邦《深度伪造责任法案》(提案)要求合成视频创制者以在视频中添加水印及个人声明的方式对“深度伪造”技术进行应用。对于违反标识义务,意图羞辱他人或者干扰政治运作、引发武力或外交冲突而发布合成视频的行为,将面临最高5年监禁的刑事处罚。欧盟则将其以“深度合成”纳入《通用数据保护条例(GDPR)》,采取了数据治理和算法规制的模式,于2022年出台了《欧盟反虚假信息行为准则》,在其新推出的《人工智能法案》中对相关问题也进行了规定:“对于与自然人直接交互的人工智能系统,人工智能系统提供者应明确告知用户他们正在与人工智能系统进行互动,并确保人工智能系统的输出以机器可读格式标记,且可被检测。”而德国、新加坡、英国、韩国等则试图将深度伪造纳入刑法规定范围。

我国 2023 年施行的《互联网信息服务深度合成管理规定》《生成式人工智能服务管理暂行办法》作为专门的统一性立法,对利用AI技术实施违法犯罪行为也进行了规制,旨在要求深度合成服务提供者应当落实信息安全主体责任,建立健全用户注册、算法机制机理审核、科技伦理审查、信息发布审核、数据安全、个人信息保护、反电信网络诈骗、应急处置等管理制度,具有安全可控的技术保障措施。

我国监管部门也已经意识到互联网信息传播的信任基础需要被重塑,且迫在眉睫,而生成合成内容的标识将是重建信任边界的重要工具。

根据《互联网信息服务深度合成管理规定》第十七条,深度合成服务提供者提供上述规定之外的深度合成服务的,应当提供显著标识功能,并提示深度合成服务使用者可以进行显著标识。我们理解这些场景可能包括非人声生成合成、非人脸图像视频生成合成等。

2024年9月14日,网信办发布《人工智能生成合成内容标识办法(征求意见稿)》及其配套强制性国家标准《网络安全技术 人工智能生成合成内容标识方法(征求意见稿)》,以进一步明确添加标识的具体要求。

根据上述意见稿的规定,在中国境内应用算法推荐技术、深度合成技术或生成式人工智能技术提供互联网信息服务的服务提供者是标识办法及标准征求意见稿的主要义务主体。此外,提供网络信息内容传播平台服务的服务提供者、互联网应用程序分发平台、用户均具有义务履行或者配合履行标识义务。

根据服务性质的不同,提供者有义务对相关生成合成内容添加显式或/和隐式标识,《办法征求意见稿》相关规定介绍如下:

服务提供者提供的生成合成服务属于如下情形的(即《互联网信息服务深度合成管理规定》第十七条第一款),应当按照下列要求对生成合成内容添加显式标识。显式标识是指在生成合成内容或者交互场景界面中添加的,以文字、声音、图形等方式呈现并可被用户明显感知到的标识。

文本内容:提供智能对话、智能写作等模拟自然人进行文本的生成或者编辑服务的,应在文本的起始、末尾、中间适当位置添加文字提示或通用符号提示等标识,或在交互场景界面或文字周边添加显著的提示标识;

人声、仿声内容:提供合成人声、仿声等语音生成或者显著改变个人身份特征的编辑服务的,应在音频的起始、末尾或中间适当位置添加语音提示或音频节奏提示等标识,或在交互场景界面中添加显著的提示标识;

人脸内容:提供人脸生成、人脸替换、人脸操控、姿态操控等人物图像、视频生成或者显著改变个人身份特征的编辑服务的,应在图片的适当位置添加显著的提示标识;涉及视频的,在视频起始画面和视频播放周边的适当位置添加显著的提示标识,可在视频末尾和中间适当位置添加显著的提示标识;

虚拟场景:提供沉浸式拟真场景等生成或者编辑服务的,应当在起始画面的适当位置添加显著的提示标识,可在虚拟场景持续服务过程中的适当位置添加显著的提示标识;

其他场景:其他可能导致公众混淆或者误认的生成合成服务场景,应当根据自身应用特点添加具有显著提示效果的显式标识。

中国、欧盟、美国等各国立法机构均已具有相当程度的共识,需对人工智能生成合成内容的溯源及真实性核验加强监管。可以预见,生成合成内容的标识将成为未来人工智能领域执法的重点。

网络平台检测实践:以技术对抗技术

麻省理工学院媒体实验室列出了一些值得注意的深度伪造的明显特征,包括:

1. 眨眼和嘴唇动作:是否遵循自然节奏?

2. 眼睛和眼镜中的反射:是否一致?是否在视觉上合理?

3. 皮肤年龄与眼睛和头发的年龄是否匹配?

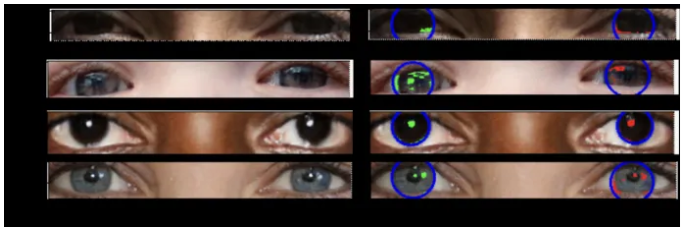

在深度伪造的图像中,眼睛的反射通常不一致,如右上方的绿色和红色标记所示。

图片来源:Adejumoke Owolabi/赫尔大学

英国赫尔大学的一项新研究指出,眼睛可以说明一切。如果两只眼睛的反射相匹配,那可能是真实的图像,如果反射不一致,则很可能是伪造的。

“假阳性和假阴性的情况也可能出现;这种方法不是万无一失的,”研究人员之一Kevin Pimbblet教授提醒道,“但是,如果把检测深度伪造看作一场军备竞赛,观察眼睛反射的方法为我们提供了一个基础的进攻计划。”[ 摘自公众号“世界经济论坛”文章《如何识别深度伪造?专家这样说》]

Meta表示,其已经开发出一种AI工具,通过对AI生成的单一图像进行逆向工程,从单个AI生成的图像返回到用于生成它的生成模型,从而检测深度伪造。Meta和McAfee等公司已经在设计的检测软件的检测因素包括:生物信号:根据血液流经面部而导致的面部肤色的自然变化;音位-视位不匹配:嘴形动态的发音有时与口语音素不同或不一致;面部动作:面部运动和头部运动的相关性来提取一个人的特征运动等。[ 参见:https://analyticsindiamag.com/top-ai-based-tools-techniques-for-deepfake-detection/ ]

谷歌发布了一个大型的视觉深度伪造数据集,并将其纳入Face Forensics基准。微软推出了视频认证工具——Microsoft Video Authenticator,可以分析静态照片或视频,以提供媒体被人为操纵的百分比机会或置信度分数。它通过检测人眼可能无法检测到的 deepfake 和微妙的褪色或灰度元素的混合边界来工作。

除此之外,我们也看到各大社交平台、视频网络也都通过修改其平台规则及用户政策,以贴合法律要求,在保护平台自身利益的情况下有条件地规制Deepfake内容。比如X平台(推特)通过一套复杂的规则识别有伪造嫌疑的推文,并告知相应的发布者删除其伪造内容。而TikTok 则在2023年更新的平台社区准则中规定,不仅所有涉及Deepfake视频都必须明确披露其为合成(synthetic)、虚假(fake or not real)或受更改(altered),同时还禁止了用户发布除公众人物之外的涉及个人形象的Deepfake视频,但即使是针对公众人物的Deepfake视频,也对产品代言、社会影响等方面做出了大量限制。

结语

技术本身是中立的,但可以成为人类向善或作恶的工具;人工智能的发展前景令人期待,但同时也面临着挑战,我们认为未来对于Deepfake相关技术的监管趋势会着重于技术供应商以及平台管理方,从源头上控制AI技术的运用。而对于用户在Deepfake的使用方面,在现有法律框架下已经能够实现基本覆盖。但一旦因技术发展导致的新型社会危害或犯罪形式的出现,则势必需要针对该技术出台特别规范以填补“大框架”基本法的立法留白。